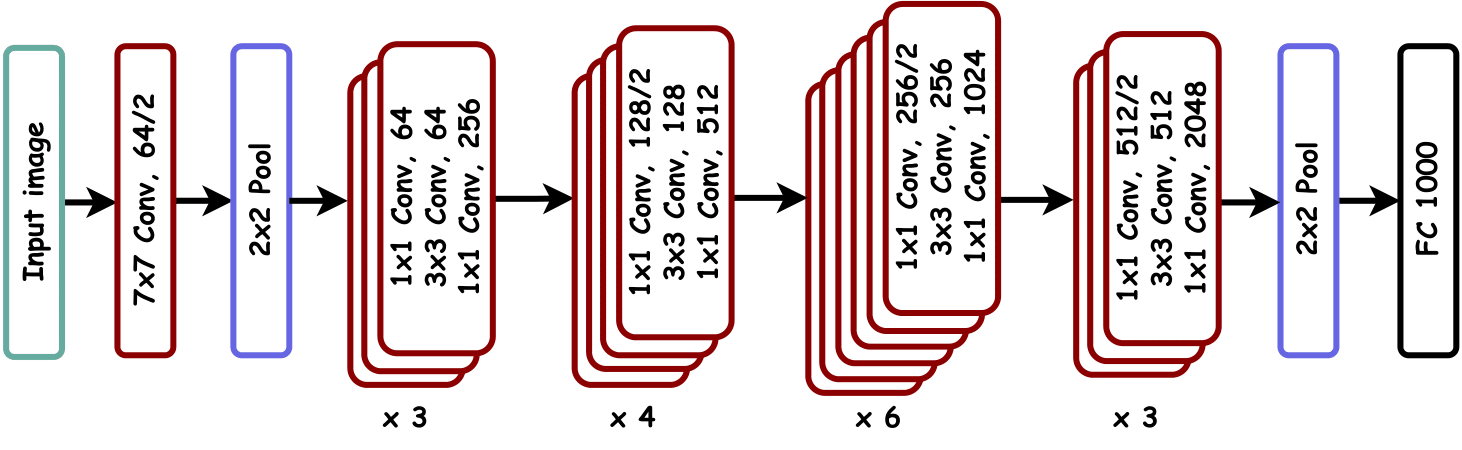

Arquitectura ResNet-50

Red neuronal residual de 50 capas adaptada para procesar 4 canales de entrada (T1, T1ce, T2, FLAIR) en lugar de los 3 canales RGB estándar. Uso de fine-tuning completo para especialización en clasificación de gliomas.

Sistema de diagnóstico asistido por IA utilizando ResNet-50 y validación mediante Grad-CAM++ para clasificación confiable de tumores cerebrales

La clasificación preoperatoria de gliomas en Alto Grado (HGG) y Bajo Grado (LGG) es un paso crítico para la planificación terapéutica. Sin embargo, la evaluación humana mediante Imágenes de Resonancia Magnética (MRI) presenta variabilidad significativa.

Este proyecto presenta un modelo de clasificación basado en arquitectura ResNet-50, modificado para procesar las 4 modalidades de MRI (T1, T1ce, T2, FLAIR) del dataset BraTS 2020. El modelo alcanzó una capacidad de discriminación excepcional, con un balanced accuracy (exactitud balanceada) de 0.98 en el conjunto de prueba.

Figura 1: Diagrama esquemático de la arquitectura ResNet-50 adaptada para 4 canales de entrada

Red neuronal residual de 50 capas adaptada para procesar 4 canales de entrada (T1, T1ce, T2, FLAIR) en lugar de los 3 canales RGB estándar. Uso de fine-tuning completo para especialización en clasificación de gliomas.

Utilización del benchmark internacional BraTS (Brain Tumor Segmentation Challenge) que incluye 4 modalidades de MRI y máscaras de segmentación ground-truth de 3 zonas tumorales: núcleo necrótico, edema y realce.

Normalización Z-score basada en estadísticas globales del conjunto de entrenamiento. Slices 2D de 240×240 píxeles co-registradas y apiladas en tensores de 4 canales para entrada al modelo.

Entrenamiento de todos los parámetros del modelo usando el optimizador AdamW con regularización de peso desacoplada, permitiendo actualización de todas las capas convolucionales para especialización.

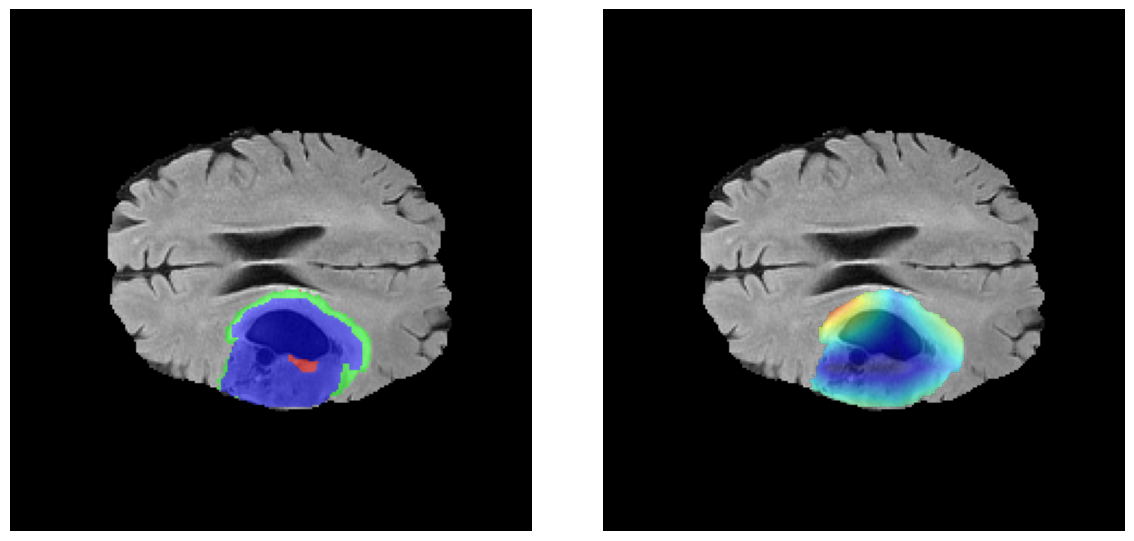

Implementación de Grad-CAM++ para generar mapas de atención que validan que el modelo se enfoca en regiones biológicamente relevantes (núcleo necrótico y tumor realzado) y no en artefactos.

Análisis cuantitativo de la energía de atención del heatmap sobre sub-regiones tumorales (NCR, ED, ET), confirmando empíricamente que el modelo aprende a localizar áreas patológicas relevantes.

AUC (Area Under Curve)

True Positives (HGG)

True Negatives (LGG)

Balanced Accuracy

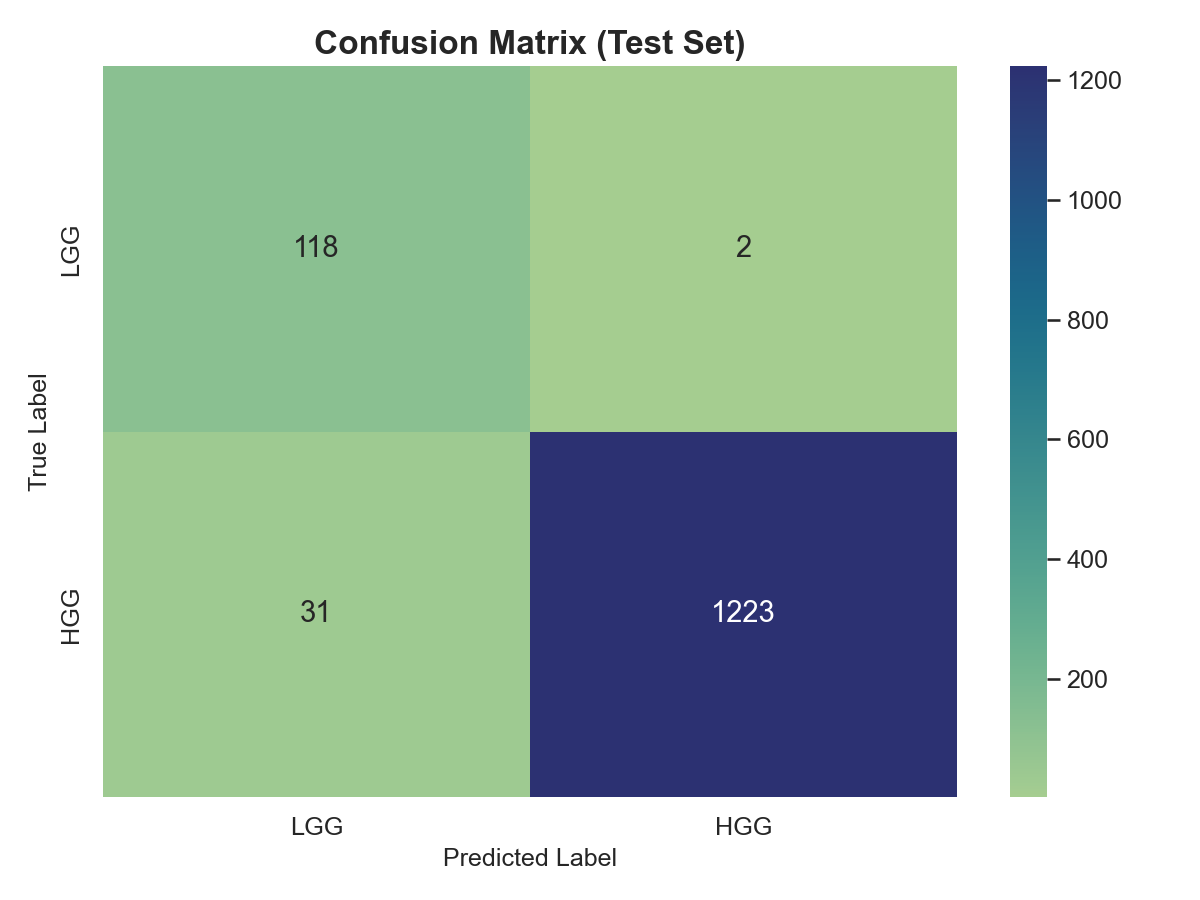

El modelo clasificó correctamente 1223 casos HGG (Verdaderos Positivos) y 118 casos LGG (Verdaderos Negativos). Solo presentó 2 casos de Falsos Positivos (LGG clasificados como HGG) y 31 casos de Falsos Negativos (HGG clasificados como LGG), demostrando una excelente capacidad de discriminación en un conjunto de prueba de 1374 muestras.

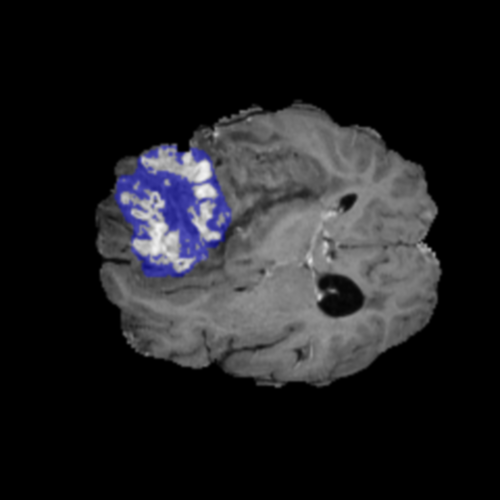

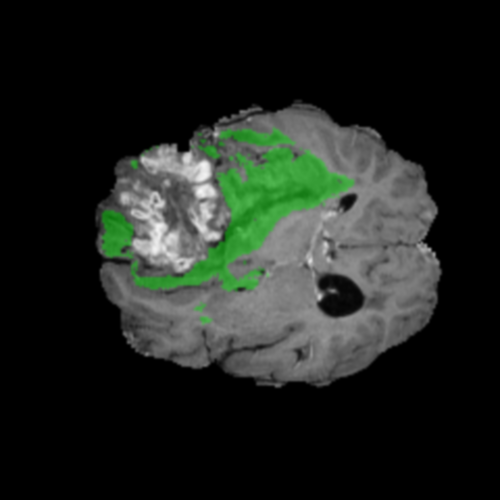

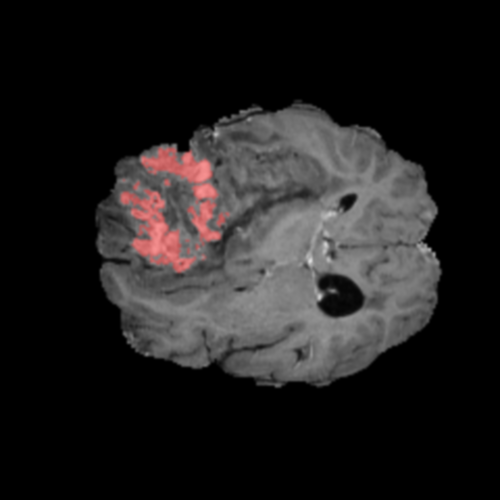

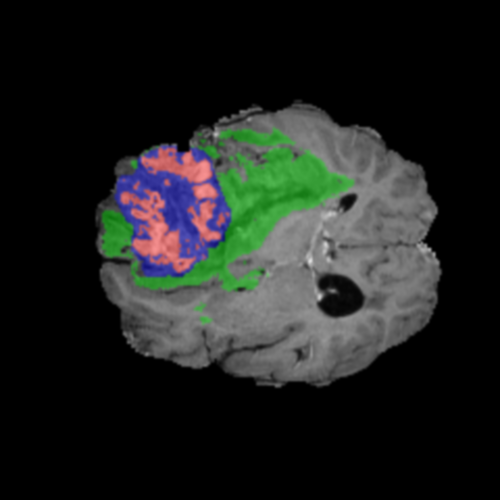

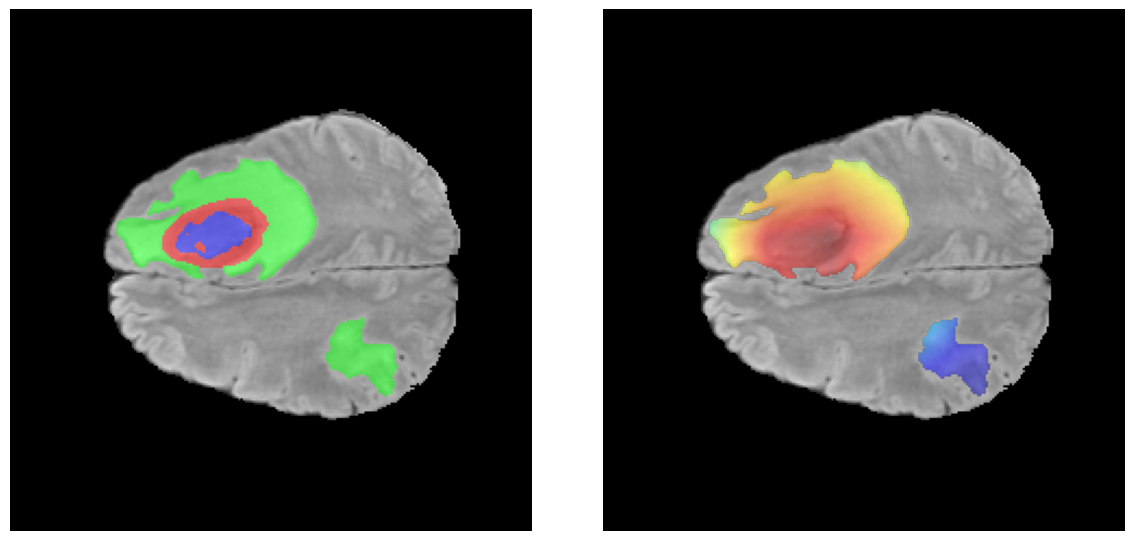

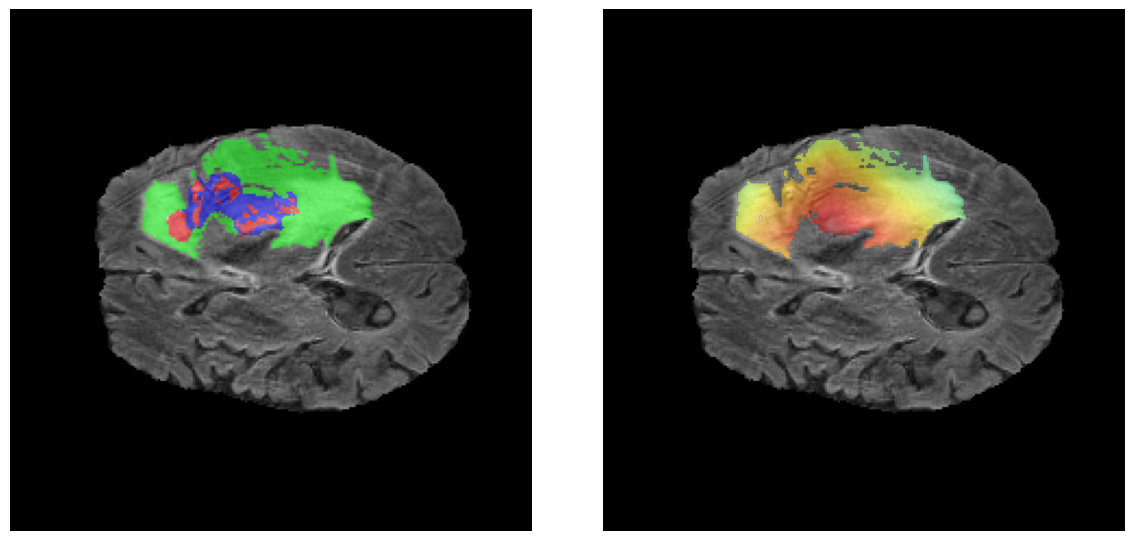

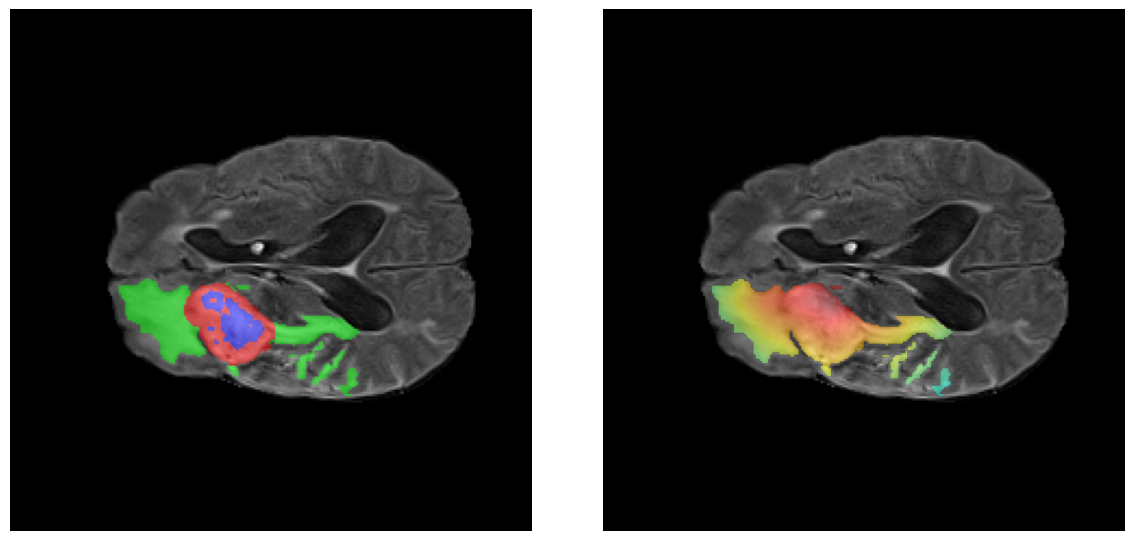

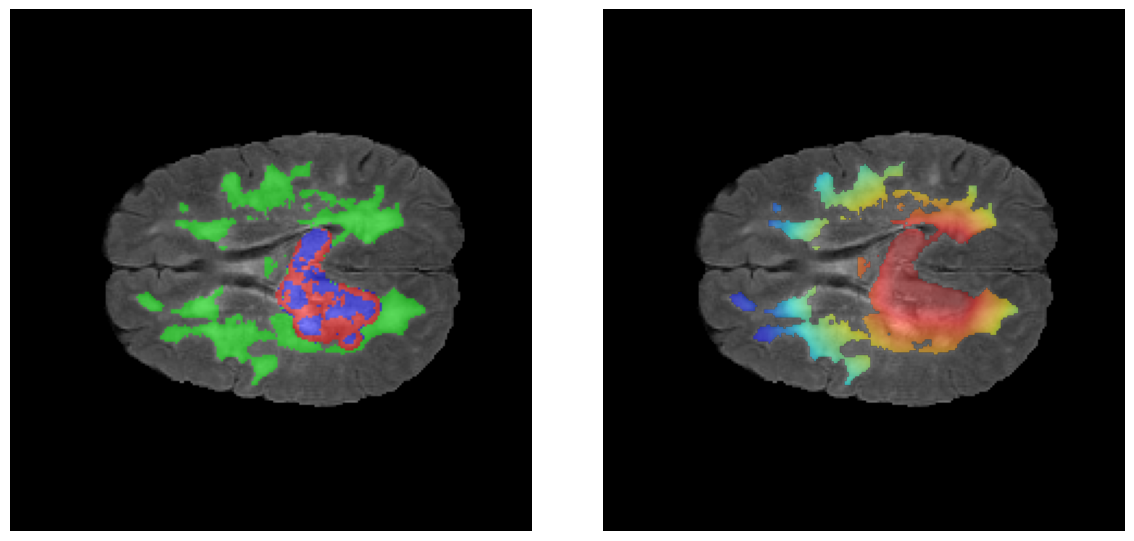

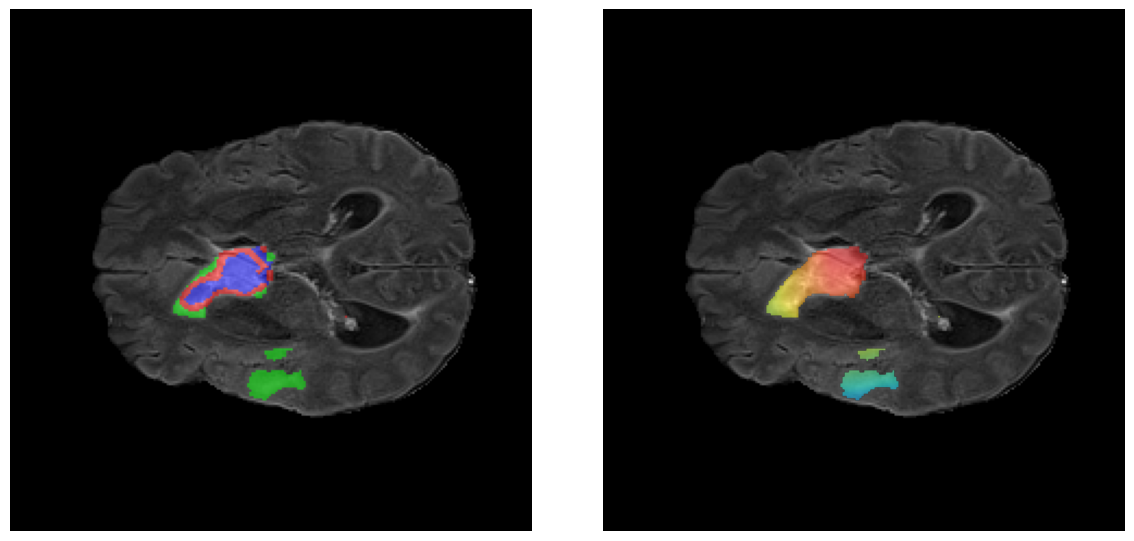

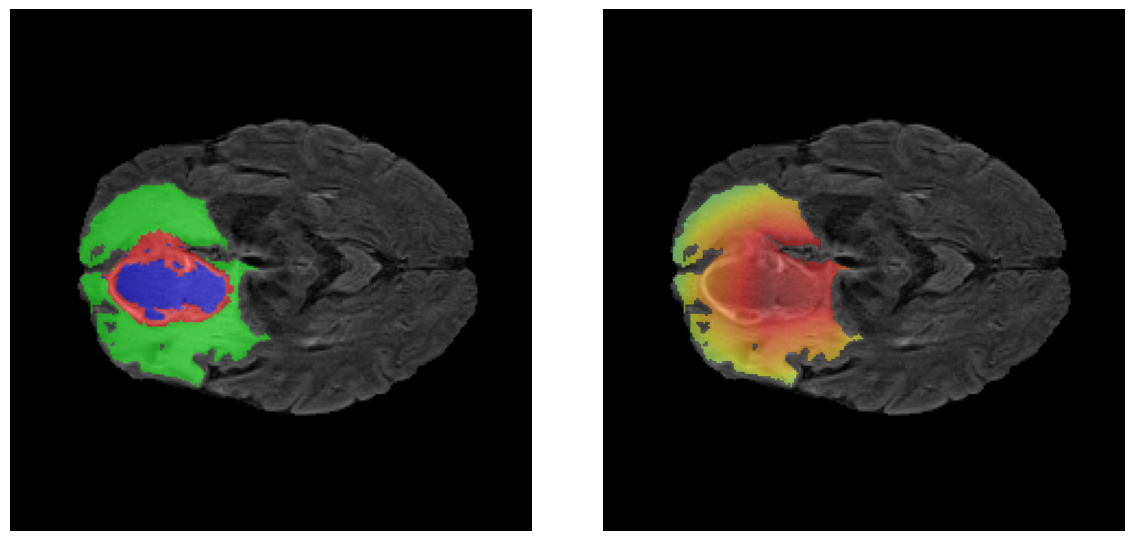

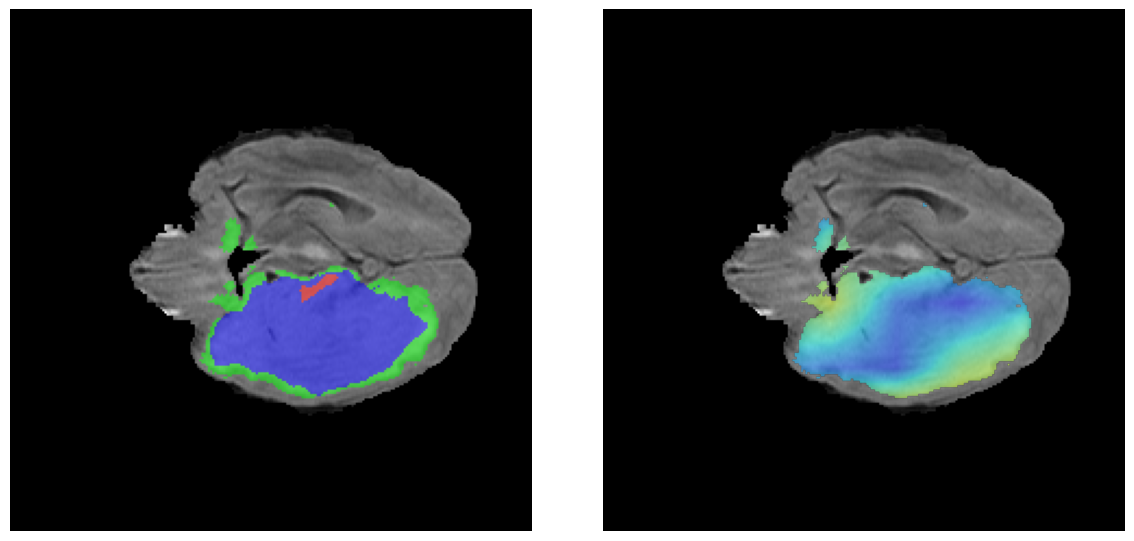

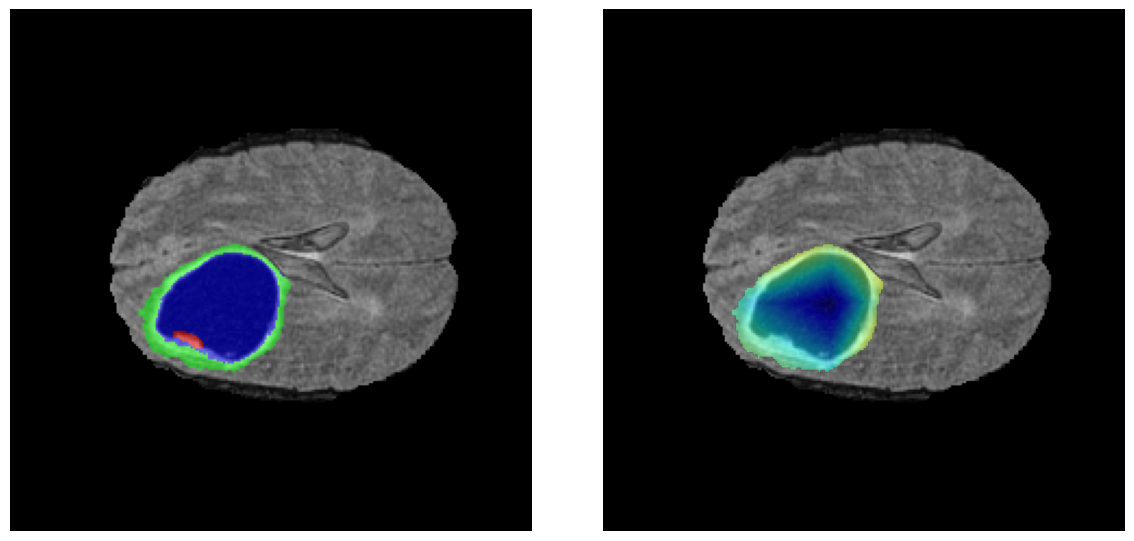

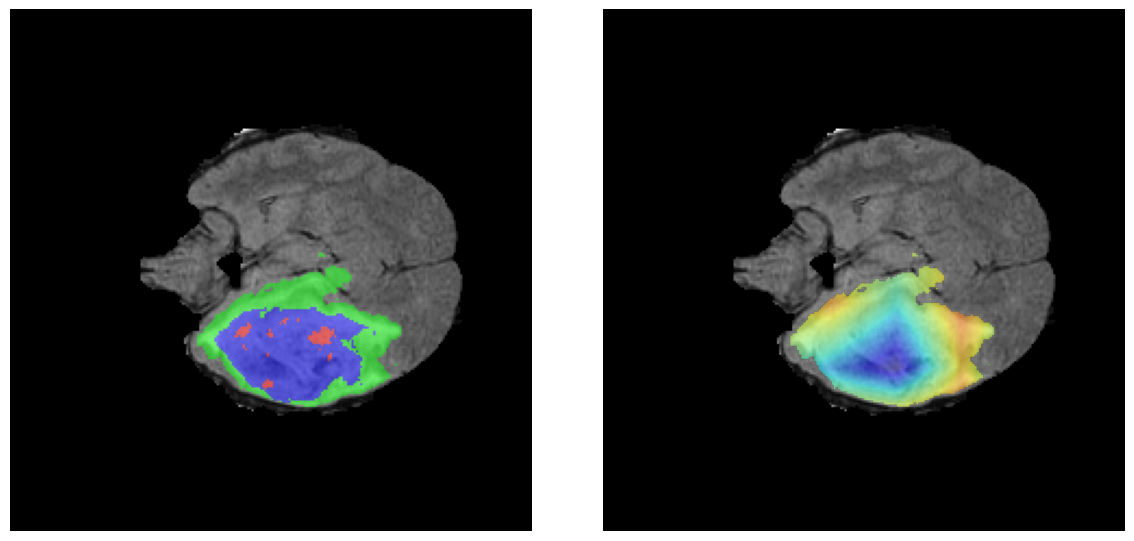

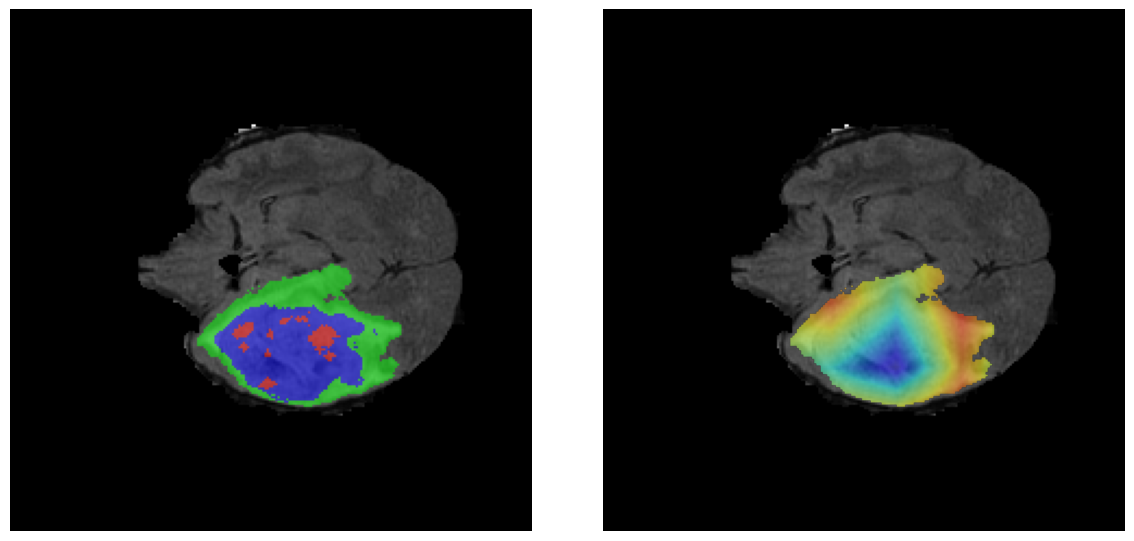

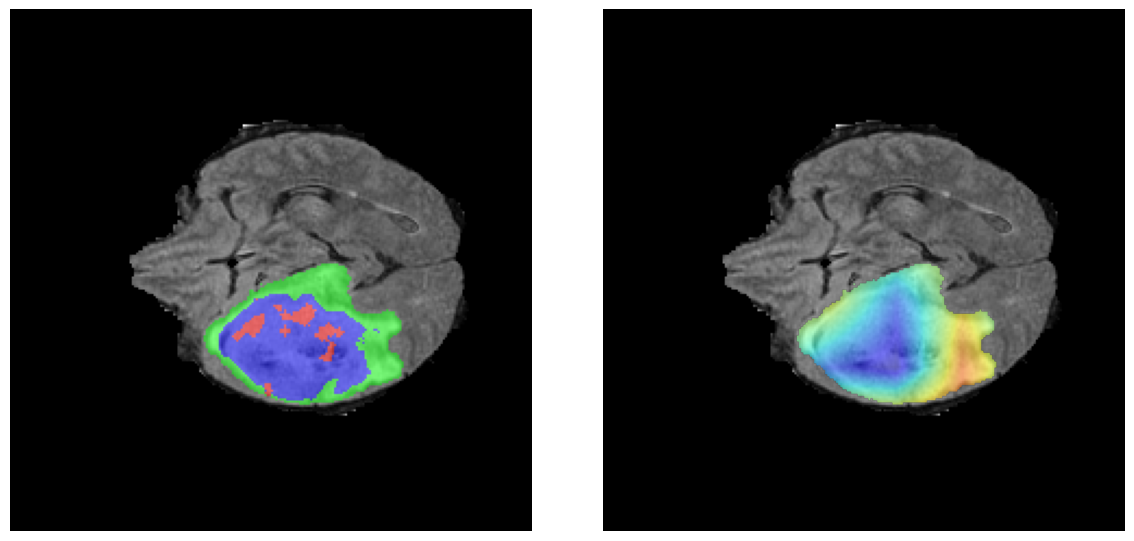

El análisis Grad-CAM++ reveló que el modelo desarrolla automáticamente la capacidad de localizar las regiones tumorales. Para casos HGG, la atención se alinea fuertemente con las regiones de Tumor Realzado (ET) y Núcleo Necrótico (NCR). En contraste, los casos LGG muestran atención más difusa, principalmente concentrada en la región de Edema Peritumoral (ED), lo cual es consistente con la patofisiología conocida de los gliomas.

AUC (Area Under Curve)

Balanced Accuracy

Muestras Evaluadas

Errores Totales

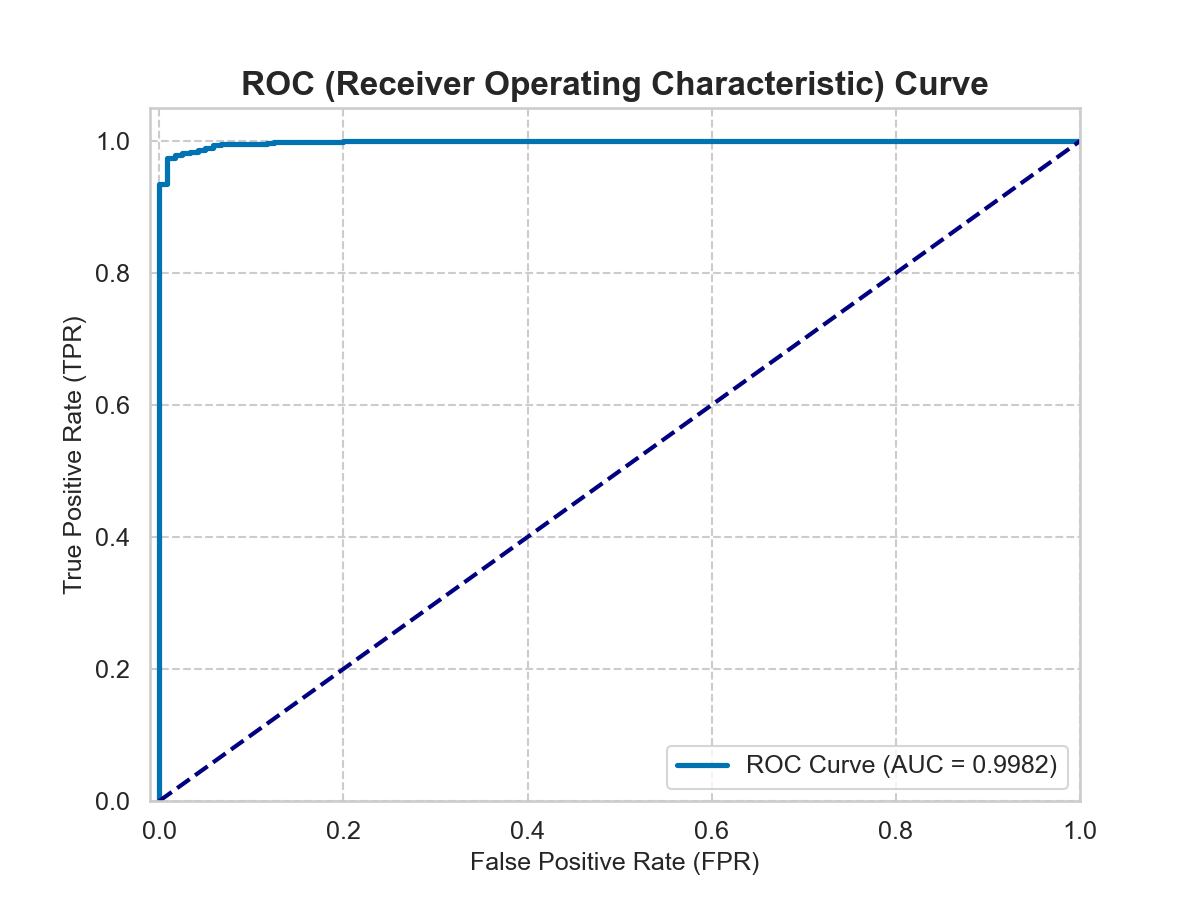

El modelo clasificó correctamente 1223 casos HGG (Verdaderos Positivos) y 118 casos LGG (Verdaderos Negativos). Solo presentó 2 Falsos Positivos y 31 Falsos Negativos, alcanzando un AUC de 0.9982 que rivaliza con el desempeño de expertos humanos, mientras proporciona consistencia y reproducibilidad superiores.

El análisis Grad-CAM++ reveló que el modelo desarrolla automáticamente la capacidad de localizar las regiones tumorales. Para casos HGG, la atención se alinea fuertemente con las regiones de Tumor Realzado (ET) y Núcleo Necrótico (NCR). En contraste, los casos LGG muestran atención más difusa, principalmente concentrada en la región de Edema Peritumoral (ED), lo cual es consistente con la patofisiología conocida de los gliomas.

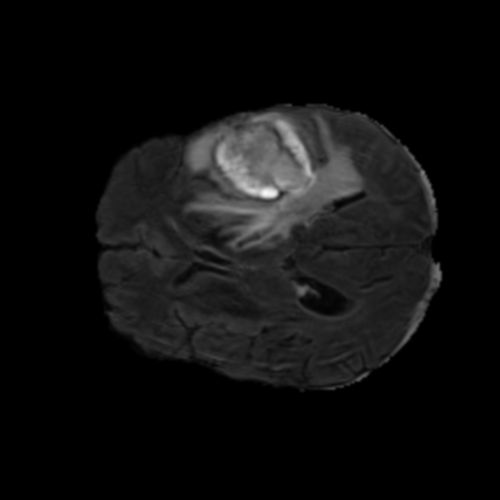

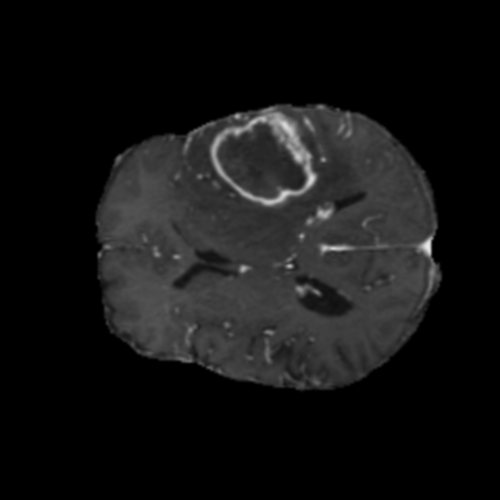

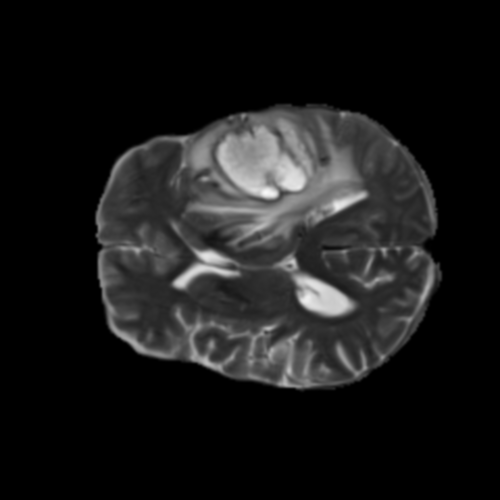

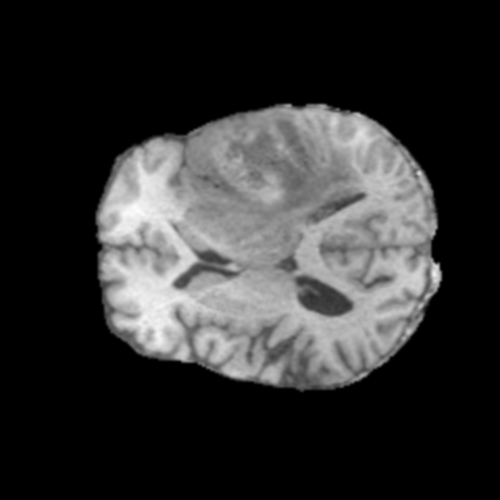

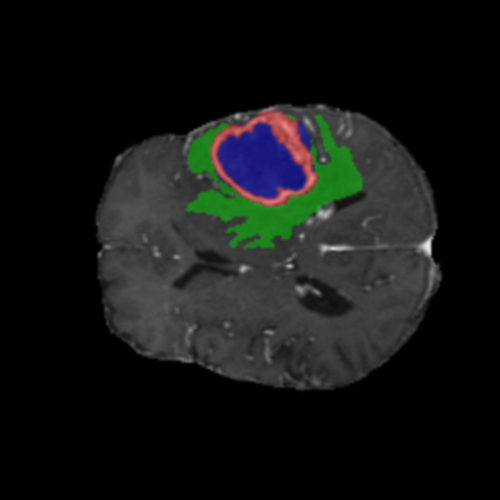

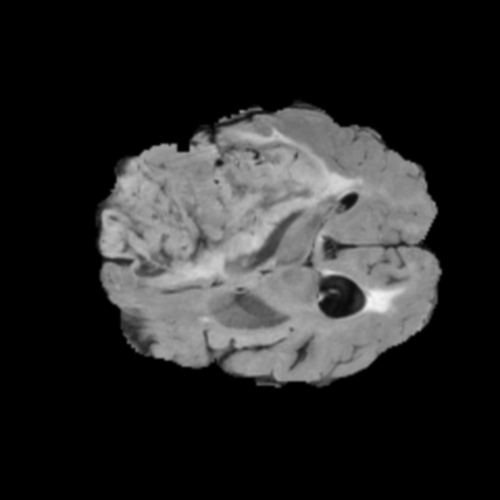

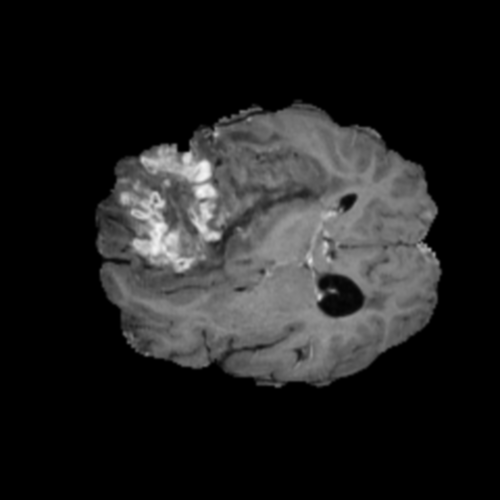

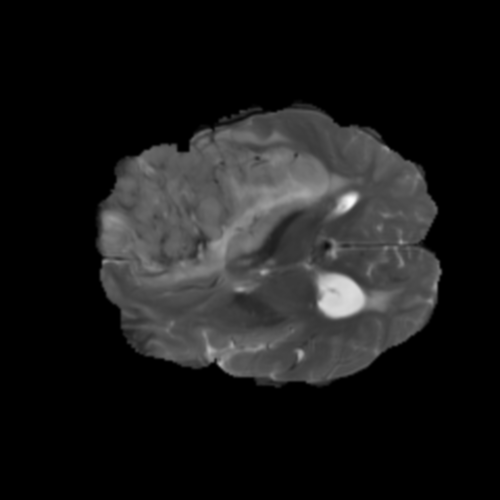

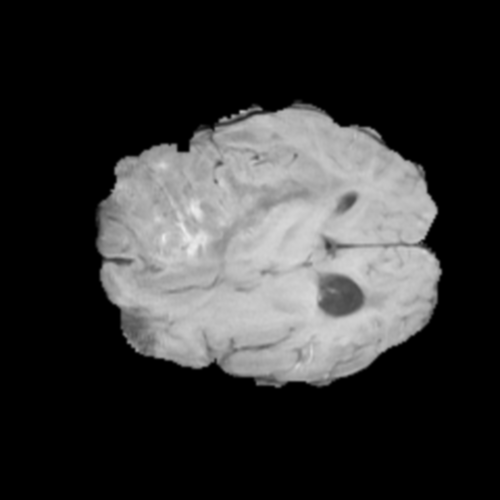

Visualización de las 4 modalidades de resonancia magnética y las segmentaciones de zonas tumorales utilizadas para entrenar el modelo

FLAIR

T1ce

T2

T1

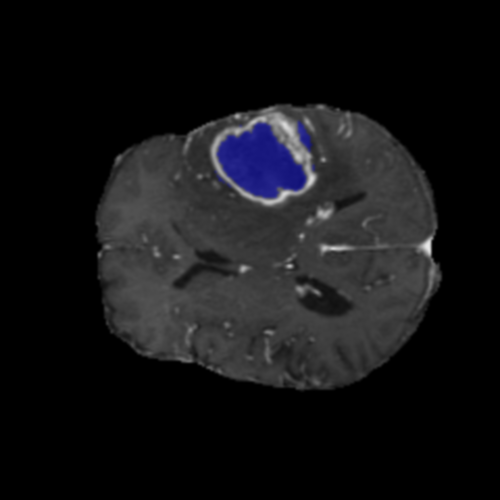

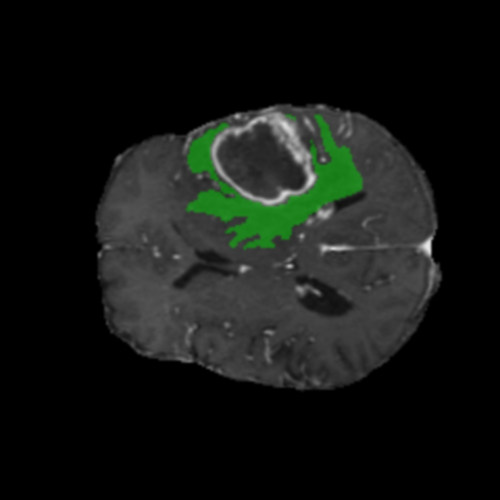

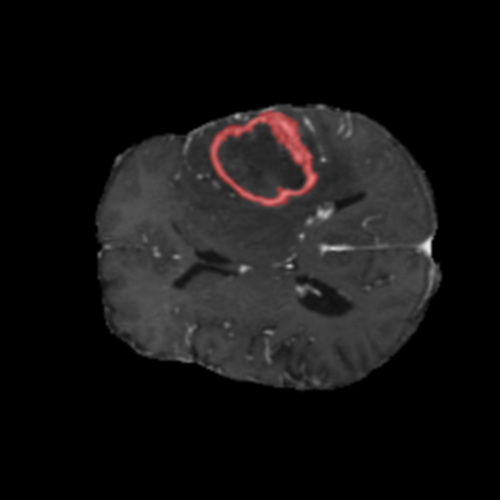

Núcleo

Edema

Realce

Tumor Completo

FLAIR

T1ce

T2

T1

Núcleo

Edema

Realce

Tumor Completo

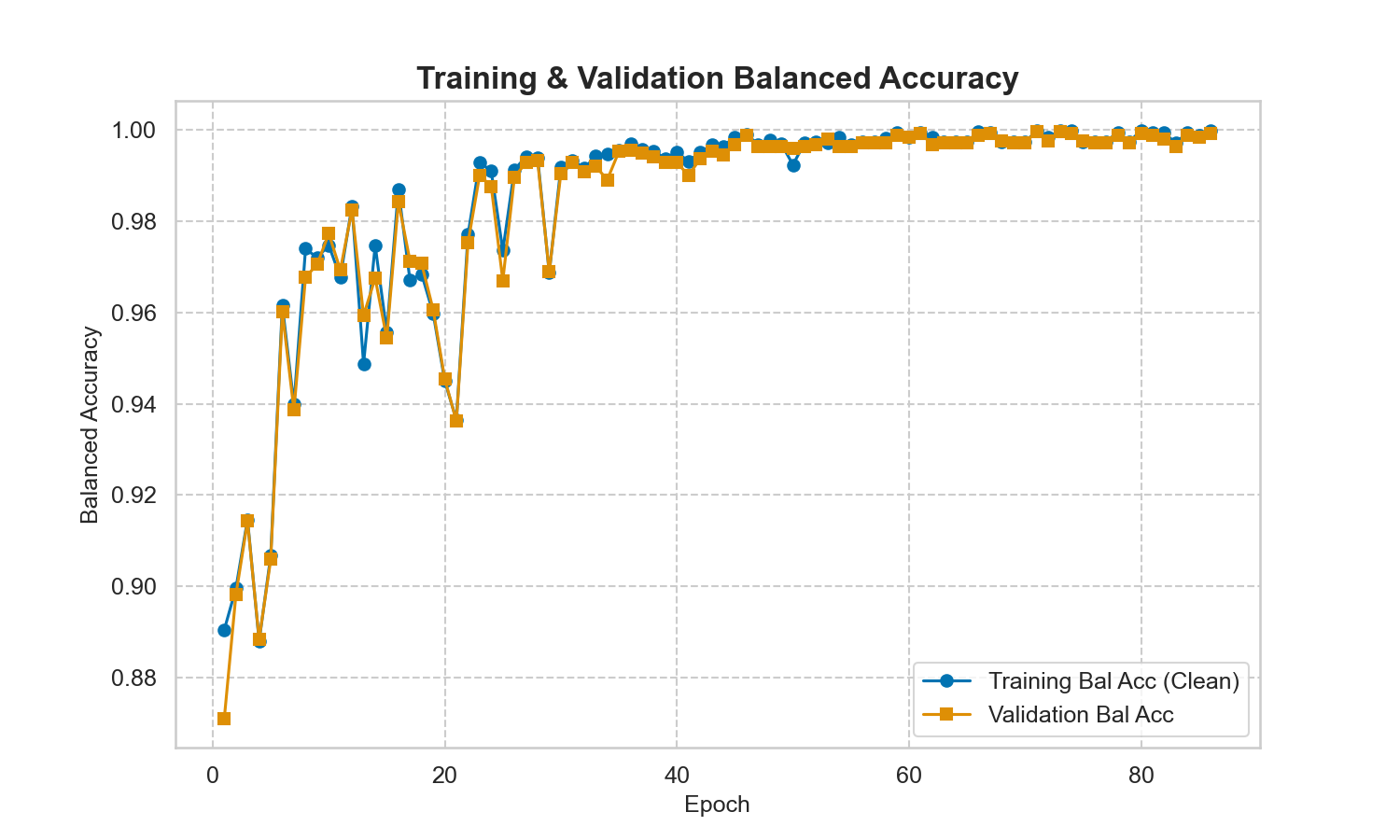

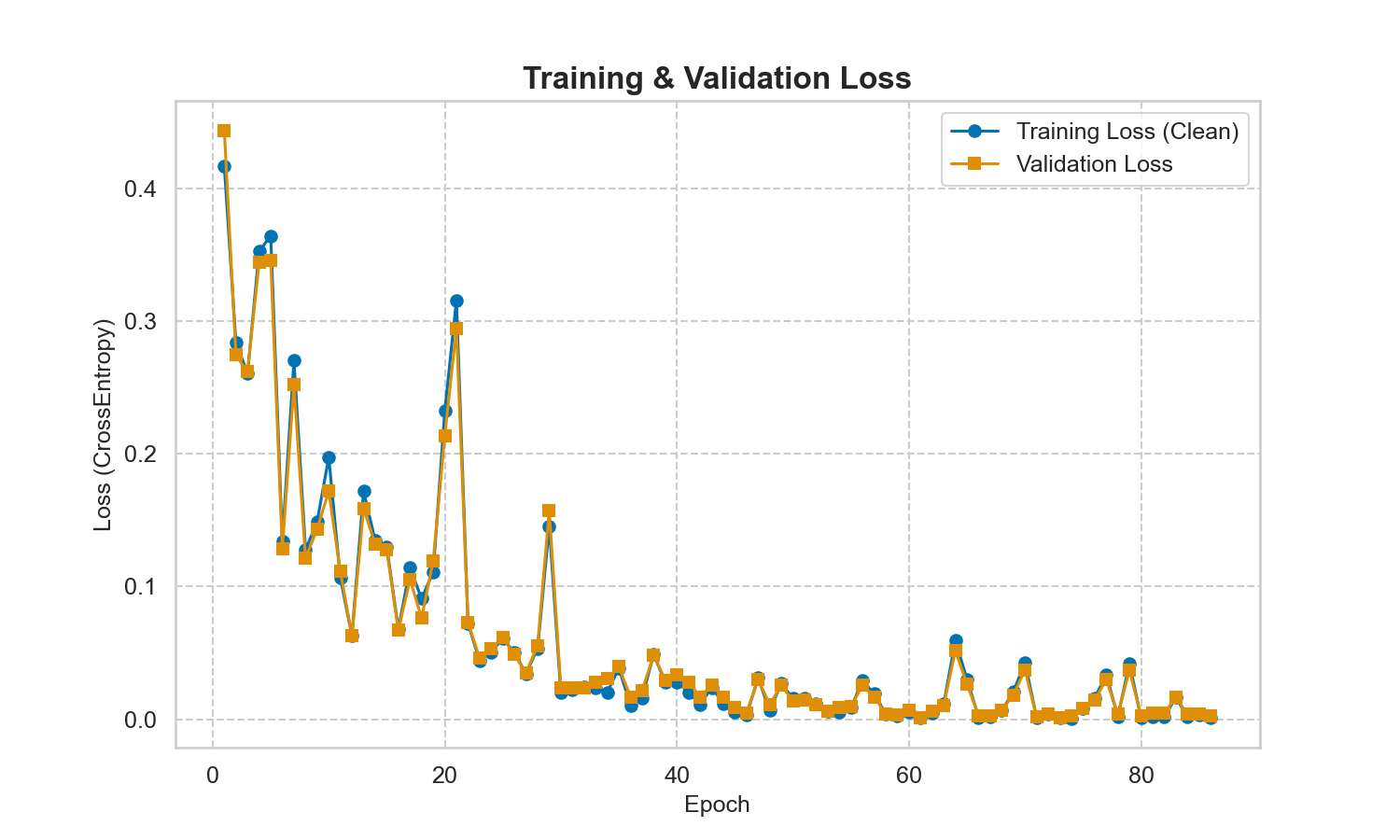

Análisis cuantitativo del rendimiento del modelo durante entrenamiento y evaluación

1223 True Positives (HGG) y 118 True Negatives (LGG). Solo 2 Falsos Positivos y 31 Falsos Negativos en 1374 muestras.

AUC de 0.9982, indicando capacidad de discriminación casi perfecta entre HGG y LGG.

Convergencia entre training y validation cerca de 1.0, demostrando aprendizaje efectivo sin overfitting.

Disminución drástica del error con valores bajos y cercanos entre training y validation.

Visualización de las regiones de atención del modelo que validan su razonamiento clínicamente relevante

Los heatmaps muestran que el modelo concentra su atención en las regiones de Tumor Realzado (rojo) y Núcleo Necrótico (azul), características patológicas clave de los gliomas de alto grado.

Para casos LGG, la atención del modelo es más difusa y se concentra principalmente en la región de Edema Peritumoral (verde), consistente con la naturaleza más infiltrativa y menos agresiva de estos tumores.

El sistema proporciona una segunda opinión objetiva y reproducible para radiólogos, reduciendo la variabilidad inter-observador en la interpretación de imágenes MRI. La alta precisión (AUC 0.9982) lo convierte en una herramienta confiable para apoyo en la toma de decisiones clínicas.

La clasificación preoperatoria precisa entre HGG y LGG es fundamental para determinar la agresividad del tratamiento (cirugía, radioterapia, quimioterapia). Este sistema permite una planificación más informada y potencialmente mejores resultados para los pacientes.

A diferencia de modelos "caja negra", la validación mediante Grad-CAM++ demuestra que las predicciones se basan en características biológicamente relevantes. Esta transparencia aumenta la confianza clínica y facilita la adopción en entornos hospitalarios.

La metodología desarrollada es transferible a otros problemas de clasificación médica por imagen: detección de neumonía en radiografías, clasificación de lesiones cutáneas, gradación de retinopatía diabética, entre otros. El framework de IA explicable es aplicable a cualquier dominio que requiera confianza en las decisiones del modelo.

PyTorch, ResNet-50, Transfer Learning, Fine-tuning

Grad-CAM++, Saliency Maps, Attention Visualization

NumPy, Z-score Normalization, Image Co-registration

ROC-AUC, Confusion Matrix, Balanced Accuracy

El modelo, entrenado únicamente con etiquetas de clasificación a nivel de imagen (HGG/LGG), desarrolló automáticamente la capacidad de localizar las regiones tumorales sin supervisión explícita de segmentación. Este es un hallazgo significativo que demuestra capacidades emergentes del deep learning.

La validación cuantitativa confirmó que las predicciones del modelo se basan en sub-regiones biológicamente relevantes (Núcleo Necrótico y Tumor Realzado para HGG; Edema Peritumoral para LGG), alineándose con el conocimiento patológico establecido.

Este trabajo demuestra que la alta precisión y la explicabilidad validada no son objetivos mutuamente excluyentes. El enfoque dual de rendimiento excepcional (AUC 0.9982) más interpretabilidad rigurosa representa un avance hacia sistemas de IA médica confiables y adoptables clínicamente.

Aunque demostrado en neuro-oncología, este framework es transferible a múltiples industrias

Detección de neumonía en radiografías de tórax, clasificación de nódulos pulmonares, identificación de fracturas óseas. Cualquier tarea de clasificación por imagen médica se beneficia de este enfoque de IA explicable.

Gradación de retinopatía diabética, detección de glaucoma, clasificación de degeneración macular relacionada con la edad (AMD). La explicabilidad es crucial para confianza clínica en diagnóstico oftalmológico automatizado.

Clasificación de biopsias histopatológicas, gradación de cáncer de próstata (Gleason score), detección de metástasis en ganglios linfáticos. El modelo puede adaptarse a imágenes de microscopía con ajustes mínimos.

Inspección de calidad visual automatizada, detección de defectos en líneas de producción, clasificación de componentes electrónicos. La explicabilidad permite entender qué características constituyen un defecto.

Detección de enfermedades en cultivos mediante imágenes de drones, clasificación de frutas/vegetales por madurez, identificación de plagas. Los mapas de atención ayudan a validar que el modelo detecta síntomas reales.

Detección de daños en vehículos, clasificación de defectos de pintura, análisis de desgaste de componentes. La trazabilidad de decisiones es importante para seguros y reclamaciones de garantía.

AUC de 0.9982 rivaliza con el desempeño de expertos humanos, mientras proporciona consistencia y reproducibilidad que supera la variabilidad inter-observador humana.

Grad-CAM++ proporciona visualización intuitiva de las regiones que influyen en cada predicción, permitiendo que médicos validen y confíen en las decisiones del sistema.

Una vez entrenado, el modelo clasifica imágenes en milisegundos, permitiendo integración en flujos de trabajo clínicos sin interrupciones ni demoras significativas.

La arquitectura y metodología son fácilmente adaptables a nuevos problemas de clasificación por imagen con minimal fine-tuning, reduciendo tiempo y costo de desarrollo.

El modelo puede ser reentrenado con nuevos datos para mejorar continuamente, adaptándose a variaciones en protocolos de adquisición o poblaciones de pacientes.

Podemos adaptar esta metodología probada a su problema específico de clasificación por imagen, ya sea en salud, manufactura, agricultura u otra industria